-

1 Kullback-Leibler information

French\ \ nombre d'informations de Kullback-LeiblerGerman\ \ Kullback-Leibler-InformationszahlDutch\ \ informatiegetal van Kullback-LeiblerItalian\ \ numero di informazione di Kullback-LeiblerSpanish\ \ número de información de Kullback-LeiblerCatalan\ \ informació de Kullback-LeiblerPortuguese\ \ informação de Kullback-LeiblerRomanian\ \ -Danish\ \ Kullback-Leibler informationNorwegian\ \ -Swedish\ \ -Greek\ \ πληροφορία των Kullback-LeiblerFinnish\ \ Kullbackin-Leiblerin informaatioHungarian\ \ Kullback-Leibler-féle információs számTurkish\ \ Kullback-Leibler bilgisiEstonian\ \ Kullback-Leibleri informatsioonLithuanian\ \ Kullback ir Leibler informacijos kiekis; Kullback ir Leibler informacijos indeksas; Kulbako ir Leiblerio informacijos kiekis; Kulbako ir Leiblerio informacijos indeksasSlovenian\ \ -Polish\ \ liczba informacji Kullbacka-LiebleraRussian\ \ информация Куллбека-ЛейблераUkrainian\ \ -Serbian\ \ -Icelandic\ \ Kullback-Leibler upplýsingarEuskara\ \ Kullback-Leibler informazioaFarsi\ \ -Persian-Farsi\ \ اطلاع کولبک-ليبلرArabic\ \ المعلومات لكولباش وليبلرAfrikaans\ \ Kullback-Leibler-inligtingsgetalChinese\ \ 库 尔 贝 克 ― 莱 伯 尔 信 息 数Korean\ \ 쿨백-라이블러 정보 -

2 количество информации по Кульбаку

количество информации по Кульбаку

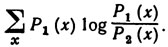

Мера неопределенности распределения вероятностей Р1(х) относительно распределения P2(x); ее выражение имеет вид

[Сборник рекомендуемых терминов. Выпуск 94. Теория передачи информации. Академия наук СССР. Комитет технической терминологии. 1979 г.]Тематики

EN

Русско-английский словарь нормативно-технической терминологии > количество информации по Кульбаку

-

3 количество информации по Кульбаку

Programming: Kullback information (см. Теория передачи информации. Терминология. Вып. 94. М.: Наука, 1979)Универсальный русско-английский словарь > количество информации по Кульбаку

См. также в других словарях:

Information Mutuelle — Dans la théorie des probabilités et la théorie de l information, l information mutuelle de deux variables aléatoires est une quantité mesurant la dépendance statistique de ces variables. Elle se mesure souvent en bit. L information mutuelle d un… … Wikipédia en Français

Information mutuelle — Dans la théorie des probabilités et la théorie de l information, l information mutuelle de deux variables aléatoires est une quantité mesurant la dépendance statistique de ces variables. Elle se mesure souvent en bit. L information mutuelle d un… … Wikipédia en Français

Kullback–Leibler divergence — In probability theory and information theory, the Kullback–Leibler divergence[1][2][3] (also information divergence, information gain, relative entropy, or KLIC) is a non symmetric measure of the difference between two probability distributions P … Wikipedia

Information theory — Not to be confused with Information science. Information theory is a branch of applied mathematics and electrical engineering involving the quantification of information. Information theory was developed by Claude E. Shannon to find fundamental… … Wikipedia

Kullback-Leibler-Information — Die Begriffe Kullback Leibler Divergenz (kurz KL Divergenz), Kullback Leibler Entropie, Kullback Leibler Information oder Kullback Leibler Abstand (nach Solomon Kullback und Richard Leibler) bezeichnen ein Maß für die Unterschiedlichkeit zweier… … Deutsch Wikipedia

Kullback-Leibler-Abstand — Die Begriffe Kullback Leibler Divergenz (kurz KL Divergenz), Kullback Leibler Entropie, Kullback Leibler Information oder Kullback Leibler Abstand (nach Solomon Kullback und Richard Leibler) bezeichnen ein Maß für die Unterschiedlichkeit zweier… … Deutsch Wikipedia

Kullback-Leibler-Distanz — Die Begriffe Kullback Leibler Divergenz (kurz KL Divergenz), Kullback Leibler Entropie, Kullback Leibler Information oder Kullback Leibler Abstand (nach Solomon Kullback und Richard Leibler) bezeichnen ein Maß für die Unterschiedlichkeit zweier… … Deutsch Wikipedia

Kullback-Leibler-Entropie — Die Begriffe Kullback Leibler Divergenz (kurz KL Divergenz), Kullback Leibler Entropie, Kullback Leibler Information oder Kullback Leibler Abstand (nach Solomon Kullback und Richard Leibler) bezeichnen ein Maß für die Unterschiedlichkeit zweier… … Deutsch Wikipedia

Kullback-Leibler-Divergenz — Die Begriffe Kullback Leibler Divergenz (kurz KL Divergenz), Kullback Leibler Entropie, Kullback Leibler Information oder Kullback Leibler Abstand (nach Solomon Kullback und Richard Leibler) bezeichnen ein Maß für die Unterschiedlichkeit zweier… … Deutsch Wikipedia

Information bottleneck method — The information bottleneck method is a technique introduced by Tishby et al [1] for finding the best tradeoff between accuracy and complexity (compression) when summarizing (e.g. clustering) a random variable X, given a joint probability… … Wikipedia

Information theory and measure theory — Measures in information theory = Many of the formulas in information theory have separate versions for continuous and discrete cases, i.e. integrals for the continuous case and sums for the discrete case. These versions can often be generalized… … Wikipedia